6月19日上午,抖音黑料

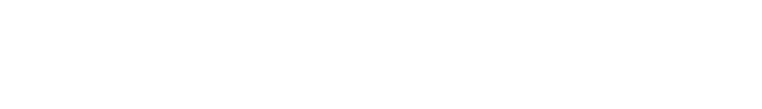

邀请到澳大利亚格里菲斯大学青年学者侯哲博士为抖音黑料

师生做了一场题为“Trustworthy AI Agents Require the Integration of Large Language Models and Formal Methods”的学术报告。

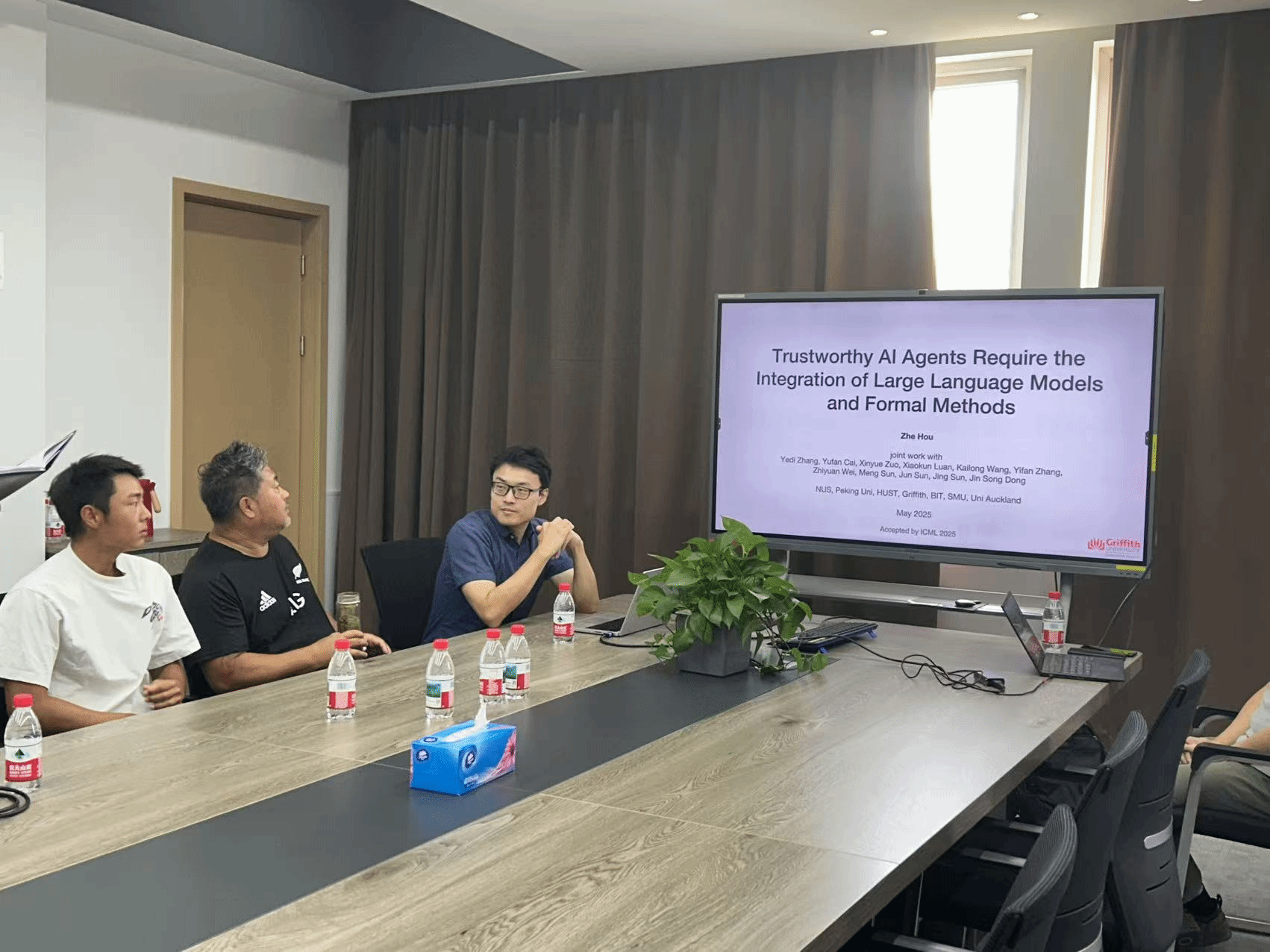

当前以深度学习、大语言模型为代表的AI技术在世界范围内学术界、产业界获得极大关注。尽管大语言模型已经被应用于各个领域,但其固有的缺陷如幻觉问题等可能导致其输出不准确甚至错误,这给各种基于大语言模型的垂直应用带来极大安全风险,特别是在各种安全攸关应用场景中。

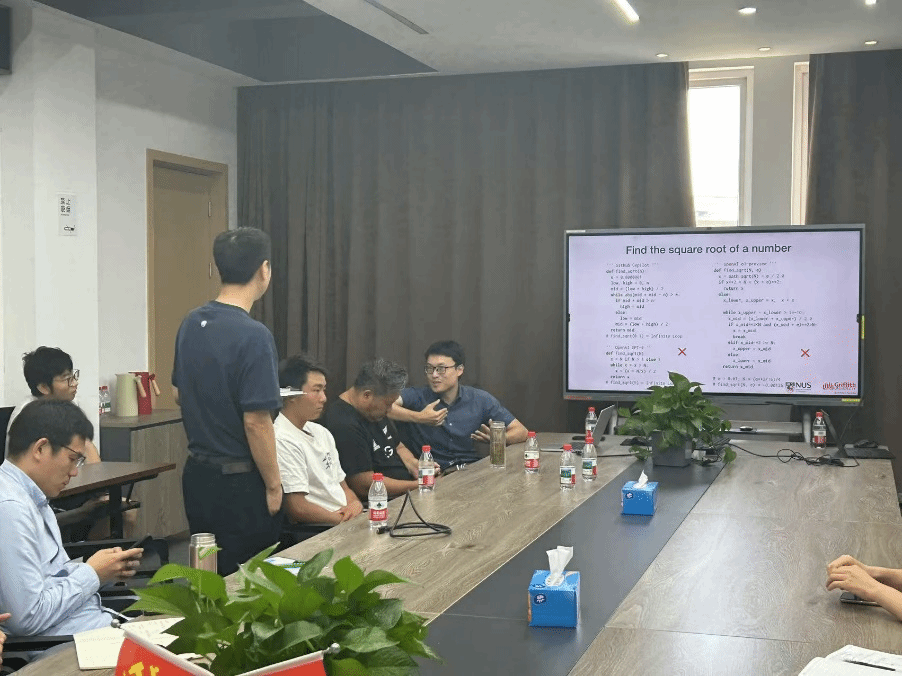

为了解决基于大模型的AI应用的可信性问题,侯博士及其研究团队提出将严格的形式化验证方法与LLM模型结合以构建可信AI应用。形式化方法一般指运用具有严格语法语义的数学或逻辑语言来描述、刻画研究对象并对其进行可信推理或证明等,因此是保证系统正确性的核心手段。侯博士及其研发团队开发出人工智能模型解释和可信验证工具Silas以确保机器学习模型的可靠性、公平性与可解释性等。Silas目前已被下载超过5万次,用户包括澳大利亚布里斯班医院、昆州海港、法国IMT和奥克兰大学等机构。Silas在辅助驾驶汽车的行驶安全保证、智慧医疗诊断的可解释性等关键应用领域具有重要应用价值。

侯哲老师博士毕业于澳大利亚国立大学, 2015年进入南洋理工大学做博士后,2019年进入格里菲斯大学工作,其主要研究方向包括可信AI、形式化方法、可信软件工程、大语言模型推理技术等。

抖音黑料

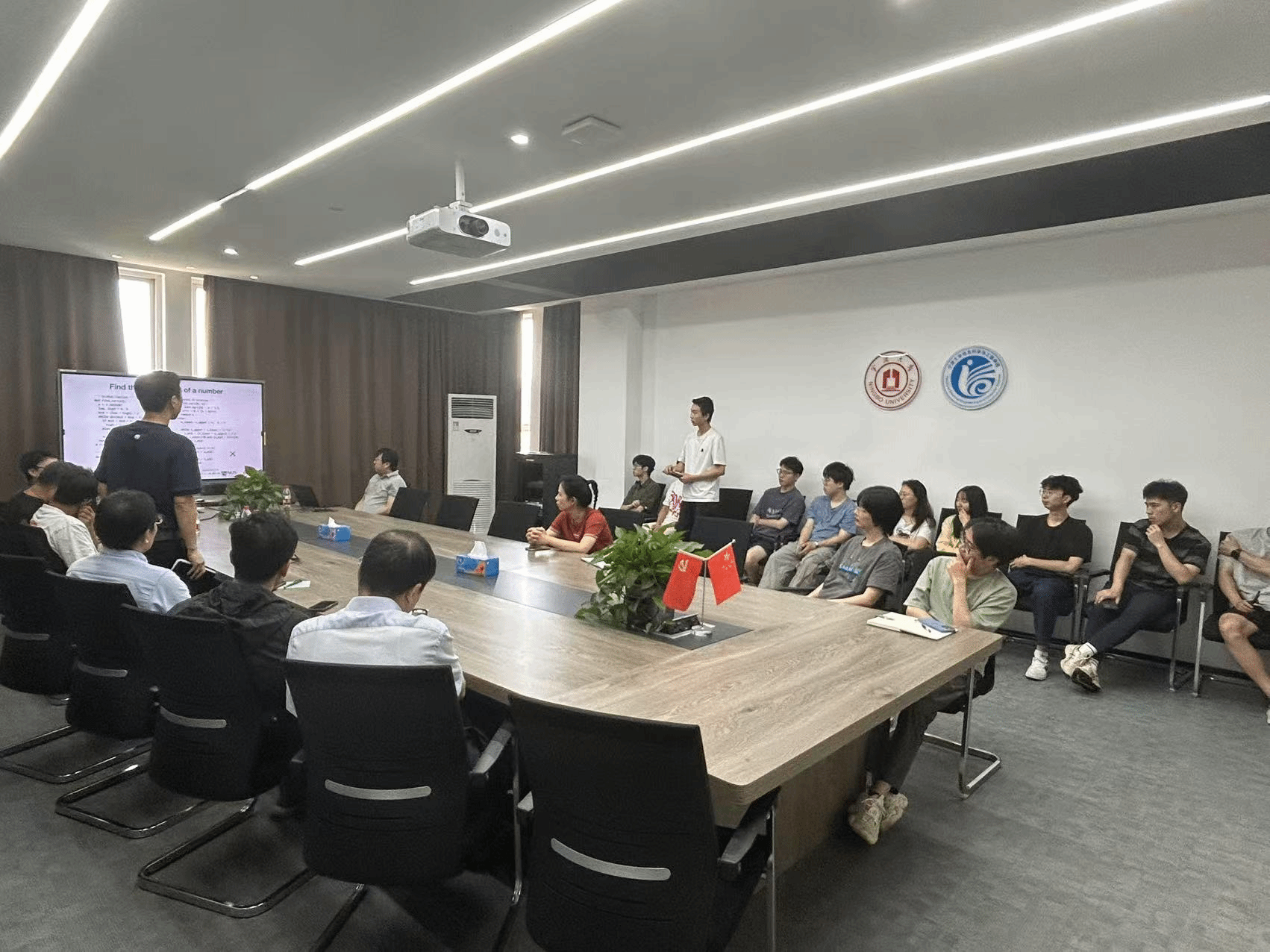

相关研究领域的30多位老师和研究生参加了本次学术报告,并与侯博士进行了热烈而深入的学术探讨。计算机学科相关研究团队近年来在可信人工智能技术及应用等方面取得重要研究进展,已承担重要市级科技攻关项目。团队成员将进一步与澳大利亚格里菲斯大学等世界一流高校深入开展学术交流合作,为人工智能技术的安全应用贡献力量。